한빛미디어에서 모집하는 혼공학습단 활동의 일환으로 혼자 공부하는 머신러닝+딥러닝 책을 공부하고 정리한 글입니다. 책은 제 돈으로 구매했습니다. 원본 코드는 저자 박해선 님의 깃허브에서 보실 수 있습니다.

Chapter 01 나의 첫 머신러닝

01-1 인공지능과 머신러닝, 딥러닝

인공지능이란

인공지능(artificial intelligence)은 사람처럼 학습하고 추론할 수 있는 지능을 가진 컴퓨터 시스템을 만드는 기술입니다.

위 시기를 극복한 후 인공지능은 다시 각광을 받기 시작했습니다.

인공지능은 강인공지능과 약인공지능으로 나눌 수 있습니다.

머신러닝이란

머신러닝은 규칙을 일일이 프로그래밍하지 않아도 자동으로 데이터에서 규칙을 학습하는 알고리즘을 연구하는 분야입니다.

딥러닝이란

머신러닝 알고리즘 중 인공 신경망을 기반으로 한 방법들을 통칭하여 딥러닝이라고 부릅니다.

위와 같이 인공 신경망이 이전과 다르게 놀라운 성능을 달성하게 된 원동력으로는 아래와 같이 꼽을 수 있습니다.

- 복잡한 알고리즘을 훈련할 수 있는 풍부한 데이터

- 컴퓨터 성능의 향상

- 혁신적인 알고리즘 개발

01-2 코랩과 주피터 노트북

구글 코랩

구글 코랩(Colab)은 구글 계정만 있다면 웹 브라우저에서 무료로 파이썬 프로그램을 테스트하고 저장할 수 있는 서비스 입니다. 머신러닝 프로그램도 만들고 실습할 수 있습니다.

텍스트 셀

셀은 코랩에서 실행할 수 있는 최소 단위입니다. 텍스트 셀에서 코드에 대한 설명을 작성할 수 있습니다. HTML과 마크다운을 혼용하여 사용할 수 있습니다.

코드 셀

코드 셀에서 코드를 작성하고 실행할 수 있습니다.

노트북

코랩은 구글이 대화식 프로그래밍 환경인 주피터(Jupyter)를 커스터마이징한 것입니다. 파이썬 지원으로 시작한 주피터 프로젝트는 최근에는 다른 언어도 지원합니다. 주피터 프로젝트의 대표 제품인 노트북Notebook을 주피터 노트북이라고 부르며, 코랩에서는 프로그램 작성 단위로 코랩 노트북을 사용합니다.

01-3 마켓과 머신러닝

생선 분류 문제

한빛 마켓에서 살아 있는 생선을 판매하기 시작했습니다. ‘도미’, ‘곤들메기’, 농어’, ‘강꼬치고기’, ‘로치’, ‘빙어’, ‘송어’를 분류하는 프로그램을 만들어봅시다. 생선 데이터는 캐글에 공개된 데이터를 사용했습니다.

도미 데이터 준비하기

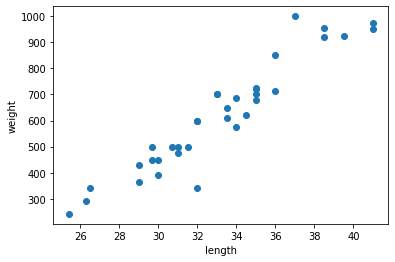

bream_length = [25.4, 26.3, 26.5, 29.0, 29.0, 29.7, 29.7, 30.0, 30.0, 30.7, 31.0, 31.0, 31.5, 32.0, 32.0, 32.0, 33.0, 33.0, 33.5, 33.5, 34.0, 34.0, 34.5, 35.0, 35.0, 35.0, 35.0, 36.0, 36.0, 37.0, 38.5, 38.5, 39.5, 41.0, 41.0]

bream_weight = [242.0, 290.0, 340.0, 363.0, 430.0, 450.0, 500.0, 390.0, 450.0, 500.0, 475.0, 500.0, 500.0, 340.0, 600.0, 600.0, 700.0, 700.0, 610.0, 650.0, 575.0, 685.0, 620.0, 680.0, 700.0, 725.0, 720.0, 714.0, 850.0, 1000.0, 920.0, 955.0, 925.0, 975.0, 950.0]import matplotlib.pyplot as plt

plt.scatter(bream_length, bream_weight)

plt.xlabel('length')

plt.ylabel('weight')

plt.show()

빙어 데이터 준비하기

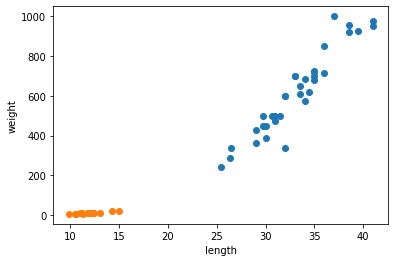

smelt_length = [9.8, 10.5, 10.6, 11.0, 11.2, 11.3, 11.8, 11.8, 12.0, 12.2, 12.4, 13.0, 14.3, 15.0]

smelt_weight = [6.7, 7.5, 7.0, 9.7, 9.8, 8.7, 10.0, 9.9, 9.8, 12.2, 13.4, 12.2, 19.7, 19.9]plt.scatter(bream_length, bream_weight)

plt.scatter(smelt_length, smelt_weight)

plt.xlabel('length')

plt.ylabel('weight')

plt.show()

첫 번째 머신러닝 프로그램, 도미와 빙어 분류

length = bream_length+smelt_length

weight = bream_weight+smelt_weightfish_data = [[l, w] for l, w in zip(length, weight)]

print(fish_data)[[25.4, 242.0], [26.3, 290.0], [26.5, 340.0], [29.0, 363.0], [29.0, 430.0], [29.7, 450.0], [29.7, 500.0], [30.0, 390.0], [30.0, 450.0], [30.7, 500.0], [31.0, 475.0], [31.0, 500.0], [31.5, 500.0], [32.0, 340.0], [32.0, 600.0], [32.0, 600.0], [33.0, 700.0], [33.0, 700.0], [33.5, 610.0], [33.5, 650.0], [34.0, 575.0], [34.0, 685.0], [34.5, 620.0], [35.0, 680.0], [35.0, 700.0], [35.0, 725.0], [35.0, 720.0], [36.0, 714.0], [36.0, 850.0], [37.0, 1000.0], [38.5, 920.0], [38.5, 955.0], [39.5, 925.0], [41.0, 975.0], [41.0, 950.0], [9.8, 6.7], [10.5, 7.5], [10.6, 7.0], [11.0, 9.7], [11.2, 9.8], [11.3, 8.7], [11.8, 10.0], [11.8, 9.9], [12.0, 9.8], [12.2, 12.2], [12.4, 13.4], [13.0, 12.2], [14.3, 19.7], [15.0, 19.9]]

fish_target = [1]*35 + [0]*14

print(fish_target)[1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0]

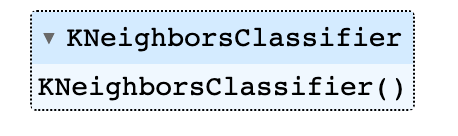

from sklearn.neighbors import KNeighborsClassifier

kn = KNeighborsClassifier()

kn.fit(fish_data, fish_target)

kn.score(fish_data, fish_target)1.0

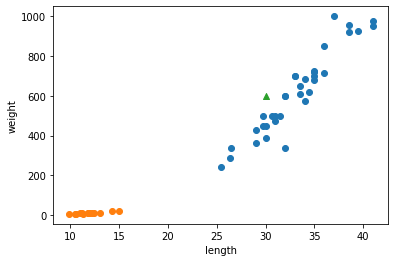

k-최근접 이웃 알고리즘

plt.scatter(bream_length, bream_weight)

plt.scatter(smelt_length, smelt_weight)

plt.scatter(30, 600, marker='^')

plt.xlabel('length')

plt.ylabel('weight')

plt.show()

kn.predict([[30, 600]])array([1])

print(kn._fit_X)[[ 25.4 242. ]

[ 26.3 290. ]

[ 26.5 340. ]

[ 29. 363. ]

[ 29. 430. ]

[ 29.7 450. ]

[ 29.7 500. ]

[ 30. 390. ]

[ 30. 450. ]

[ 30.7 500. ]

[ 31. 475. ]

[ 31. 500. ]

[ 31.5 500. ]

[ 32. 340. ]

[ 32. 600. ]

[ 32. 600. ]

[ 33. 700. ]

[ 33. 700. ]

[ 33.5 610. ]

[ 33.5 650. ]

[ 34. 575. ]

[ 34. 685. ]

[ 34.5 620. ]

[ 35. 680. ]

[ 35. 700. ]

[ 35. 725. ]

[ 35. 720. ]

[ 36. 714. ]

[ 36. 850. ]

[ 37. 1000. ]

[ 38.5 920. ]

[ 38.5 955. ]

[ 39.5 925. ]

[ 41. 975. ]

[ 41. 950. ]

[ 9.8 6.7]

[ 10.5 7.5]

[ 10.6 7. ]

[ 11. 9.7]

[ 11.2 9.8]

[ 11.3 8.7]

[ 11.8 10. ]

[ 11.8 9.9]

[ 12. 9.8]

[ 12.2 12.2]

[ 12.4 13.4]

[ 13. 12.2]

[ 14.3 19.7]

[ 15. 19.9]]

print(kn._y)[1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 0 0

0 0 0 0 0 0 0 0 0 0 0 0]

kn49 = KNeighborsClassifier(n_neighbors=49)

kn49.fit(fish_data, fish_target)

kn49.score(fish_data, fish_target)0.7142857142857143

print(35/49)0.7142857142857143

'ML & DL > 책 & 강의' 카테고리의 다른 글

| [혼공머신] Chapter 06 비지도 학습 (0) | 2023.02.12 |

|---|---|

| [혼공머신] Chapter 05 트리 알고리즘 (0) | 2023.02.05 |

| [혼공머신] Chapter 04 다양한 분류 알고리즘 (1) | 2023.01.22 |

| [혼공머신] Chapter 03 회귀 알고리즘과 모델 규제 (0) | 2023.01.15 |

| [혼공머신] Chapter 02 데이터 다루기 (0) | 2023.01.08 |

댓글